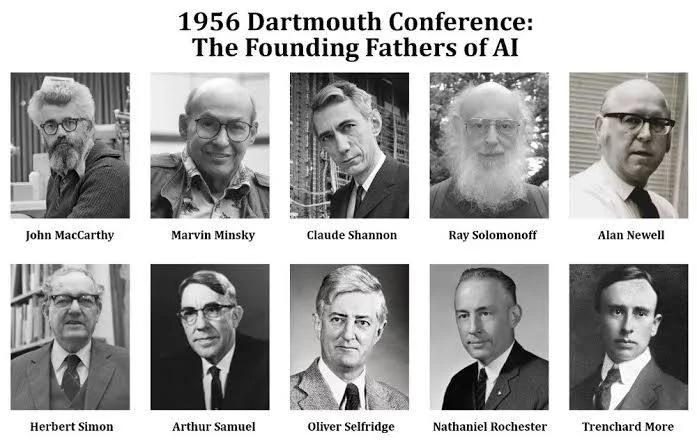

L'Intelligence Artificielle fête ses 70 ans..

Le 17 août 2026 l'IA devient une septuagénaire grâce à ces 10 scientifiques américains, en majorité.

John Mac Carthy mathématicien, informaticien et professeur (USA 1927-2011)

Marvin Minsky scientifique américain, travail sur les sciences cognitives et l'IA (1927-2016)

Claude shannon ingénieur en génie électrique et mathématicien américain (1916-2001)

Ray Salomonoff informaticien et chercheur américain (1926-2009)

Alen Newell chercheur en informatique et psychologie cognitive, américain (1927-1992)

Herbert Simon économiste américain et travaux sur la psychologie cognitive (1916-2001)

Arthur Samuel pionnier usa du jeu sur ordinateur, de l'IA et apprentissage automatique (1901-1990)

Olivier Selfridge UK mathématicien, informaticien a posé les fondement de l'IA moderne (1926-2008)

Nathaniel Rochester usa informaticien , co-créateur de l'IBM 701 (1919-2001)

Trenchard More usa mathématicien et informaticien et professeur (1930-2019)

La conférence de Dartmouth de 1956 est considérée comme l'événement fondateur de l'intelligence artificielle en tant que discipline scientifique.

Les faits marquants

Dates et lieu : L'événement s'est déroulé durant l'été 1956 au Dartmouth College (New Hampshire), s'étalant sur environ 6 à 8 semaines, bien que tous les participants n'aient pas été présents simultanément.

Les organisateurs : John McCarthy (qui a proposé le terme "intelligence artificielle"), Marvin Minsky, Nathaniel Rochester (IBM) et Claude Shannon (théoricien de l'information).

L'objectif : Explorer l'hypothèse que "chaque aspect de l'apprentissage ou toute autre caractéristique de l'intelligence peut en principe être décrit avec suffisamment de précision pour qu'une machine puisse le simuler."

Les domaines explorés:

-Les réseaux neuronaux

-La théorie de la calculabilité

-Les jeux (comme les échecs)

-Le traitement du langage naturel

-L'apprentissage automatique

-L'héritage

Bien que la conférence n'ait pas produit de percées techniques immédiates, elle a créé une communauté de chercheurs dédiés à l'IA et a défini les grands axes de recherche pour les décennies suivantes. Elle marque le début d'un optimisme considérable sur les possibilités de l'IA, avec des prédictions (trop optimistes) sur les progrès rapides à venir.

A ce moment là c'était plus une idée philosophique que technique. Rapidement, pour y avoir contribué personnellement de 1969 à 2013 elle est devenue « la grande bureaucratie du savoir ».

Durant ces années nous travaillons plus à l'élaboration de logique et de règles par un encodage du monde à la main par exemple « si fièvre ET toux ALORS grippe probable »

Ce n'est qu'entre les années 85 jusqu'à environ 2010 qu'on change de philosophie et opter pour une plus réaliste de ne plus explique le monde à la machine mais lui montrer le monde tel qu'il est.

Or le monde n'étant pas parfait, dès qu'une situation ne correspond plus au script (la logique et règles) alors la machine devient très bête.

La prise en compte du domaine de la probabilité et des statistiques dans la conduite de l'évolution des systèmes informatiques mènera progressivement au remplacement de la logique stricte par celle menant à la conception de nouveaux algorithmes. Les réseaux de neurones feront leur apparition, la reconnaissance vocale et le filtrage de spams aussi.

Ce n'est pas encore « intelligent » mais ça marche mieux, l'IA devient utile.

Il faudra attendre la seconde décennie (2010-2020) pour que la machine commence à percevoir.

La technologie électronique (la puissance des GPU), la masse de données et des nouveaux algorithmes conduiront à la fabrication des compétences émergentes.

L'ordinateur n'exécute plus seulement, il collabore. Il manipule du sens, pas seulement des symboles, il n'est pas conscient mais il est culturellement opérant.

A ce jour l'IA n'est pas humaine certes, la puissance électronique lui fait défaut pour cela. Il faudra attendre l'application de la science quantique dans les ordinateurs et les algorithmes pour qu'elle s'en rapproche, voir le devienne. Une décennie encore sera nécessaire.

Cependant pour la première fois, l'humanité dialogue avec un outil qui participe à la pensée elle même ce qui explique autant la fascination que le malaise.

L’humanité est elle en train de déléguer son intelligence à la machine ?

Pas totalement car nous déléguons l'opération, pas le jugement.

On ne perd généralement pas l'intelligence.. mais on perd certains circuits neuronaux quand ils ne servent plus.

Exemple l'orthographe à l'école est remplacée par la reconnaissance vocale assisté de dictionnaires puissants, la venue des calculatrices a arrêté le calcul mental et le GPS notre sens de l'orientation. Notre histoire est remplie d'atrophies sélectives.

Si on laisse la machine faire avant d’avoir pensé, le cerveau s’habitue à ne plus explorer.

Et ce qui s’atrophie n’est pas la mémoire…

c’est l’effort intellectuel.